- PrismMLが発表した「1-bit Bonsai 8B」は、80億パラメーターLLMを1.15GBに圧縮し、スマートフォンを含むエッジ環境での実用動作を実現した

- 事後量子化ではなく、埋め込み層からLMヘッドまで全体を最初から1ビット設計で学習する独自アプローチを採用している

- 独自指標「インテリジェンス密度」でQwen3 8Bの10倍超となる1.06/GBを記録。Apache 2.0ライセンスで公開済み

1-bit Bonsaiとは

米カリフォルニア工科大学発のAIスタートアップPrismMLは2026年3月31日、Large Language Model(LLM)「1-bit Bonsai」を発表した。80億パラメーター(8B)のモデルをわずか1.15GBに収めながら、同クラスのモデルと同等水準の推論精度を達成している。

モデルの重みはApache 2.0ライセンスで公開されており、研究・商用を問わず無償で利用できる。「Bonsai(盆栽)」という名称は、大規模なモデルを小さく整える手法を盆栽になぞらえたものとみられる。

事後量子化とは異なる設計思想

LLMのメモリ使用量を削減する一般的な手法として、学習済みモデルの重みを低ビット精度に変換する「量子化」がある。しかしビット数を極端に下げると推論精度が損なわれるため、実用レベルの1ビット量子化は技術的に困難とされてきた。

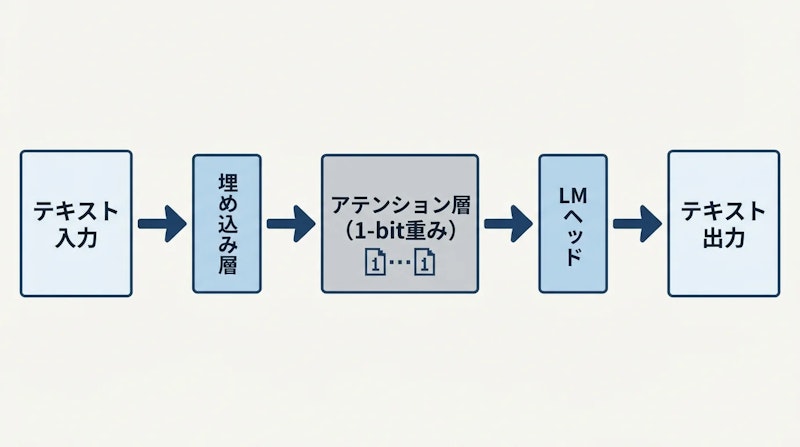

1-bit Bonsaiはこの課題を、アーキテクチャ全体を最初から1ビット設計で学習する手法で回避している。テキストを数値に変換する埋め込み層、文脈を読み取るアテンション層、回答を生成するLanguage Modeling Head(LMヘッド)まで、モデルの全層を1ビットで統一設計した。事後的にビット幅を落とすのではなく、1ビット精度でも高い性能を発揮できるよう、学習方法自体を最初から最適化した点が従来手法との根本的な違いだ。

ベンチマーク性能と指標の比較

PrismMLが公開したベンチマーク結果によると、1-bit Bonsai 8Bは同クラスの8Bモデルと匹敵するスコアを記録している。同社が独自に定義する「インテリジェンス密度」(ベンチマークの平均エラー率の負の対数をモデルサイズで割った指標)では、1-bit Bonsai 8Bが1.06/GBを達成した。

同じ8BクラスのQwen3 8Bは0.10/GBであり、1-bit Bonsaiはその10倍以上の値を示している。このインテリジェンス密度という指標は、同一パラメーター数ではなく同一ストレージ容量でのモデル比較を可能にするもので、軽量モデル同士の実用的な比較に適している。オープンな軽量モデルとしてはGoogleがエージェントタスクやAndroid向けに最適化したGemma 4も注目されているが、1-bit Bonsaiはストレージ効率という異なる切り口から競争力を示した形だ。

対応環境とオンデバイス展開

デバイス対応面では、Apple Siliconを搭載したデバイス向けにMLXフレームワーク経由での動作をサポートする。NVIDIA GPU環境ではllama.cpp(CUDAバックエンド)で動作する。1.15GBという容量はiPhoneやMacのストレージ・メモリ要件を十分に満たし得るサイズであり、クラウドAPIへの依存なしにローカルで推論を完結できる。

オンデバイス処理はプライバシー保護の観点からも有効だ。入力テキストを外部サーバーに送信せずに完結するため、医療・法務・金融など機密情報を扱う業務での活用が想定される。通信環境が制限される現場での利用や、アプリ組み込みによるオフライン動作の実現など、クラウド型LLMでは対応が難しかった用途への展開が現実味を帯びてきた。モバイルアプリ開発者や組み込みシステム開発者にとって、LLM統合コストを抑えながら高い推論性能を得られる手段として、1-bit Bonsaiの実用価値は大きい。