- PFNが国産初のフルスクラッチ推論特化LLM「PLaMo 3.0 Prime」β版の開発手法を公開

- 教師あり学習→DPO→強化学習の3段階で長考(Reasoning)能力を獲得

- 米中モデルへの依存リスク回避を目的に、国内完結型AI基盤を構築

PFN「PLaMo 3.0 Prime」β版開発資料を公開

Preferred Networks(PFN)は2026年4月5日、フルスクラッチで開発した大規模言語モデル「PLaMo 3.0 Prime」β版の開発手法に関する資料を公開しました。同モデルは既存モデルを下敷きにせず、ゼロベースで構築された国産LLMとしては初めて、長考によって高品質な回答を生成する推論(Reasoning)機能を搭載しています。

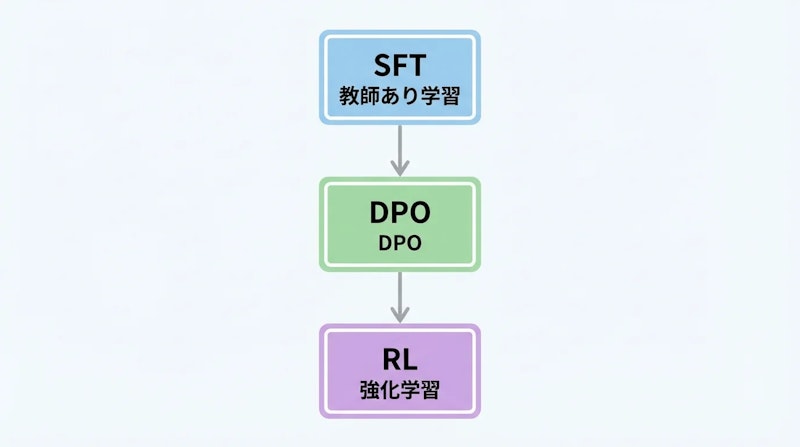

公開資料では、主に事後学習(Post-training)に焦点を当て、教師ありファインチューニング、DPO(Direct Preference Optimization)、強化学習の各段階における具体的な取り組みを解説しています。特に、推論機能を最適化するための工夫や、国産LLM開発の戦略的意義について詳細に述べられています。

Reasoning能力獲得の3段階アプローチ

PLaMo 3.0 Primeのβ版開発では、事前学習で獲得した言語能力を基盤に、3段階の事後学習プロセスを経て推論能力を強化しました。第1段階の教師ありファインチューニング(SFT)では、入力と正解出力のペアをモデルに学習させることで基礎的な指示追従能力を獲得。第2段階のDPOでは、人間の好みに沿った出力を選好するようモデルを調整しています。

第3段階では強化学習を導入し、モデルが試行錯誤を通じて自律的に出力品質を改善する仕組みを実装しています。この段階では、DeepSeek R-1などの先行モデルの開発手法を参考にしつつ、PFN独自の最適化手法を組み込んでいます。これにより、複雑な推論タスクにおいて段階的に思考プロセスを展開し、最終的な回答精度を向上させることが可能になりました。

ベンチマーク性能と国産モデルの意義

公開資料によると、PLaMo 3.0 Primeは複数のベンチマークで海外モデルに匹敵する性能を示しています。英語指示追従ベンチマーク(IFBench)および日本語指示追従ベンチマーク(JFBench)では、中国産モデル「Qwen3-235B」や「gpt-oss-120b」に肉薄する結果を達成。特にJFBenchでは国産モデルとしての強みを発揮し、日本語特有の表現やニュアンスを正確に理解する能力が確認されています。

また、関数呼び出し性能を評価するBFCL(Berkeley Function Calling Leaderboard)では、海外モデルと比較して遜色ない精度を記録しました。これは、Sakana AIの「Namazu」など他の国産LLMと並び、日本語環境での実用性を重視した開発方針が反映された成果といえます。

国産フルスクラッチLLM開発の戦略的重要性

PFNは資料の中で、国産LLM開発の戦略的必要性を強調しています。現時点では日本のAIモデル性能が米国や中国のモデルに及ばないことを認めつつも、今後も海外モデルを同条件で利用できる保証はないと指摘。地政学的リスクや輸出規制の可能性を考慮し、AI供給を他国に依存しない体制構築が不可欠だと述べています。

フルスクラッチ開発により、モデルの学習データ、アーキテクチャ、最適化手法のすべてを自社で管理できる利点があります。これにより、特定分野への特化や、日本語処理の高度化、セキュリティ要件への柔軟な対応が可能になります。PFNは今後も事後学習手法の改良を続け、推論能力のさらなる向上を目指すとしています。