- Gartnerは2026年4月9日、2028年までにグローバルの企業向け生成AIアプリの25%が年間5件以上のセキュリティインシデントを経験すると予測した

- MCP(Model Context Protocol)などのAI連携規格がセキュリティより利便性を優先した設計のため、権限昇格やプロンプトインジェクションのリスクが高まっている

- Gartnerは業務専門家によるMCPサーバのオーナーシップ確立とガードレール定義を、AI導入企業の緊急課題として推奨している

Gartnerが警告する2028年予測の背景

米Gartnerは2026年4月9日(現地時間)に発表したプレスリリースで、2028年までにグローバルの企業向け生成AIアプリケーションの25%が年間5件以上のセキュリティインシデントを経験すると予測した。生成AIの企業導入が急加速するなかで、セキュリティ体制の整備が追いついていない現状への警鐘である。

この予測の主因としてGartnerが挙げるのが、Model Context Protocol(MCP)に代表されるAI連携規格の急速な普及だ。MCPはAIエージェントを外部ツールやデータソースに接続するための共通インターフェース仕様で、2024年後半以降、多くのAIプラットフォームが採用を進めている。Anthropicが本番AIエージェント向けに公開した「Claude Managed Agents」もMCPを活用したサービスの一例であり、エージェントが外部システムと連携する場面は今後も増加する見通しだ。

MCPが生むセキュリティリスクの構造

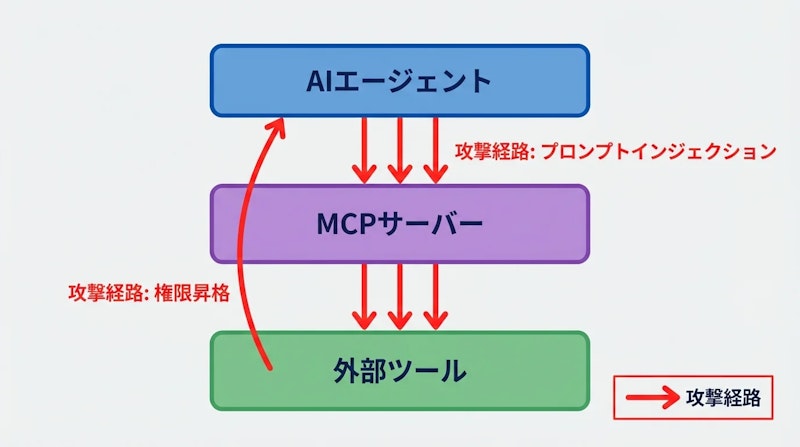

Gartnerが問題視するのは、MCPなどの連携規格が「セキュリティより利便性を優先した設計」である点だ。AIエージェントが単一のワークフロー内で、機密データへのアクセス、信頼できないコンテンツとの接触、外部システムとの通信を同時に実行する構造が、複合的なリスクを生む。

具体的に懸念される攻撃ベクターとして、権限昇格とプロンプトインジェクションが挙げられる。権限昇格とは、本来限られた権限しか持たないエージェントがMCPサーバを介して意図せず広範なリソースへのアクセスを得てしまうケースだ。プロンプトインジェクションは、外部コンテンツに埋め込まれた悪意ある指示をエージェントが処理することで、設計者が意図しない動作を引き起こす攻撃手法である。

こうしたリスクは、複数のエージェントが協調して動作するマルチエージェントアーキテクチャの普及によってさらに深刻化する。1つのエージェントへの侵害が連鎖的に他のエージェントへと波及する可能性があるためだ。

Gartnerが推奨する4つの対策

こうしたリスクに対してGartnerは、具体的な対処策として4点を提示している。第1に、MCPサーバや外部連携ツールの導入プロセスにおける厳格なレビュー体制の確立だ。どのツールや外部サービスとの接続を許可するかを事前に審査するガバナンス構造が求められる。

第2に、情報漏えいや不正操作のリスクが特に高い業務では、AIと外部システムの連携そのものを制限することが推奨される。すべての業務プロセスへのAIエージェント接続を前提とせず、リスクとベネフィットを慎重に評価した上での取捨選択が重要だ。第3に、プロンプトインジェクションや権限昇格といった既知の脅威パターンへの対処をシステム設計段階から組み込むことも不可欠とされる。

第4として、Gartnerが特に強調するのが業務専門家の関与だ。AIにデータやリソースへのアクセスを許可する前に、その業務分野の専門家がMCPサーバのオーナーシップを持ち、エージェントの動作範囲を定めるガードレールを設けるべきだと提言している。セキュリティ部門だけでなく、現場の業務知識を持つ担当者が設計段階から参画する体制が、リスク低減のカギとなる。

企業が今取るべきアクション

Gartnerの予測は「2028年までに」という時間軸を示すが、生成AIの企業導入ペースを考えれば、セキュリティ体制の整備を先送りにする余裕はない。MCPサーバの管理権限が不明確なまま生成AIを展開している企業は、今すぐオーナーシップの明確化と業務専門家との連携体制の見直しを進めることが現実的な出発点となる。

セキュリティ担当者にとっては、生成AI特有のリスク(自律的なデータアクセス、外部ツール連携、エージェント間連携)を既存のリスク管理フレームワークにどう組み込むかが、今後の重要課題だ。AIガバナンス戦略を策定していない企業は、Gartnerの提言を参考にリスクの可視化と対策ロードマップの策定を急ぐ必要がある。