- Search LiveがAIモード提供中の全言語・全地域へ拡大し、日本を含む200カ国以上で利用可能になった

- Gemini 3.1 Flash LiveはComplexFuncBench Audioで90.8%を記録し、音声のトーンや感情も識別できる

- Google Lensとの連携で、カメラが映す実世界のあらゆる対象についてリアルタイムの音声対話が行える

全世界200カ国以上への拡大

Googleは2026年3月26日、AI検索のAIモードに組み込まれた音声・カメラ対話機能「Search Live(サーチ・ライブ)」を、AIモードが提供されているすべての言語と地域へ拡大すると発表しました。これにより日本を含む200カ国以上のユーザーが、音声と映像を組み合わせたリアルタイム対話型検索を利用できるようになります。

Search Liveは、文字入力が困難な場面や手元にある物について素早く調べたい状況を想定した機能です。Google公式ブログでは「タイピングでは間に合わないリアルタイムの支援が必要なとき」のための機能と位置づけています。

Gemini 3.1の技術的特長

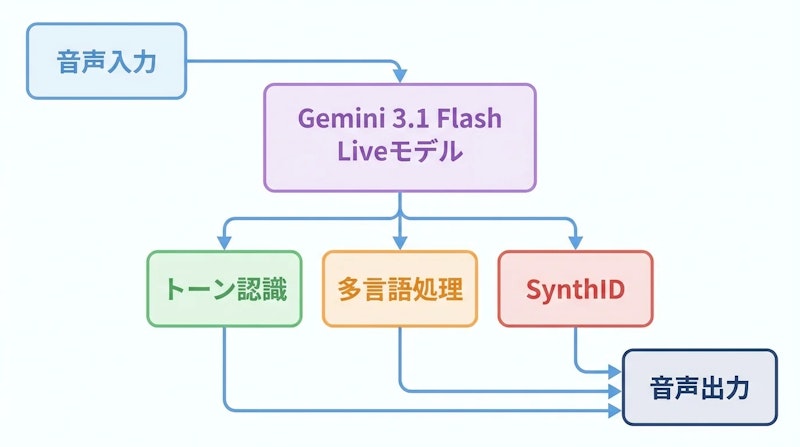

今回の全世界展開を支えるのは、Googleが同日発表した新しい音声AIモデル「Gemini 3.1 Flash Live」です。前世代と比較してより自然で直感的な会話品質を実現しており、Google製品向けとしては現時点で最高品質の音声モデルと位置づけられています。

ベンチマーク評価では、複数ステップの関数呼び出しを測定する「ComplexFuncBench Audio」で90.8%を達成し比較対象モデルの中で首位となっています。また、Scale AIの「Audio MultiChallenge」でも「thinking」モード使用時に36.1%を記録しました。このベンチマークは、割り込みや言い淀みが生じる実世界の音声対話における複雑な指示追跡と長時間推論を評価するものです。

音声のトーン認識と感情対応も強化されており、ピッチや話す速度といった音響的なニュアンスを前モデルより高い精度で把握します。ユーザーが苛立ちや困惑を示した際には応答を動的に調整する能力を備えており、顧客対応などビジネス用途での活用が期待されています。モデルの設計段階から多言語に対応しているため、ユーザーが母国語で話しかけるだけで自動的に適切な言語で応答します。

Gemini 3.1 Flash Liveが生成した音声にはGoogleのAI識別技術「SynthID」の透かし情報が埋め込まれます。人間の耳には知覚できない形で音声出力に織り込まれており、AI生成コンテンツを信頼性高く識別することで誤情報の拡散防止に役立てます。

Search Liveの利用方法

利用にはAndroidまたはiOS向けのGoogleアプリが必要です。アプリを起動してSearchバーの下にある「Live」アイコンをタップするだけで開始できます。マイクに向かって質問すると音声で回答が返ってくる仕組みで、続けて追加の質問をしたり、関連するウェブリンクを確認したりすることも可能です。

カメラを有効にすれば、目の前にある物について質問できます。たとえば棚を映しながら「この棚の組み立て方は?」と話しかけると、手順の説明と関連ウェブリンクをリアルタイムで受け取れます。Google Lensでカメラをかざしているときも、画面下部に表示される「Live」オプションをタップすればSearch Liveへアクセスでき、カメラが捉えている実世界のシーンについてそのまま対話が始まります。

Geminiの音声技術はGoogle検索にとどまらず、ドラクエXのAI音声キャラクター「おしゃべりスラミィ」など様々なプロダクトへの採用が広がっており、コンシューマー向け会話AIの実用化が加速しています。

開発者・企業向けの展開

Gemini 3.1 Flash LiveはSearch LiveやGemini Liveへの統合に加え、開発者向けにはGoogle AI StudioのGemini Live APIを通じてプレビュー公開されています。企業向けには「Gemini Enterprise for Customer Experience」でも利用できます。

Verizon、The Home Depot、LiveKitなどがすでにワークフローへ導入しており、ノイズの多い環境でのタスク処理や顧客対応の自動化での効果を評価しているとGoogleは伝えています。Gemini Liveでは前モデルと比較して応答速度が向上し、会話の文脈を維持できる長さも2倍に拡張されました。