言語・LLM

言語・LLM 多言語埋め込みを強化するLUSIFER!低リソース言語にも強い適応性

新手LUSIFERを提案し、多言語埋め込みを強化。ファインチューニングとアライメントで効果的な多言語学習を実現し、低リソース言語にも高い適応性とコスト効率を発揮。

言語・LLM

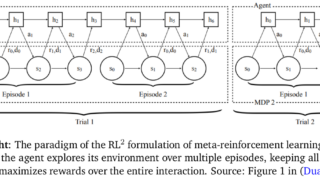

言語・LLM  強化学習

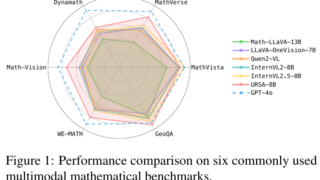

強化学習  マルチモーダル

マルチモーダル  マルチモーダル

マルチモーダル  マルチモーダル

マルチモーダル  強化学習

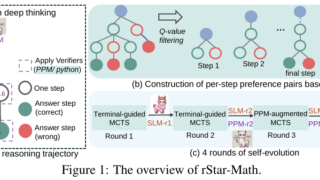

強化学習  言語・LLM

言語・LLM  強化学習

強化学習  動画

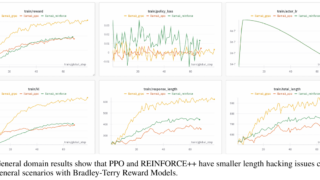

動画  強化学習

強化学習